無人機抓捕

無人機開發(基于Dji onboard SDK)

目前成果

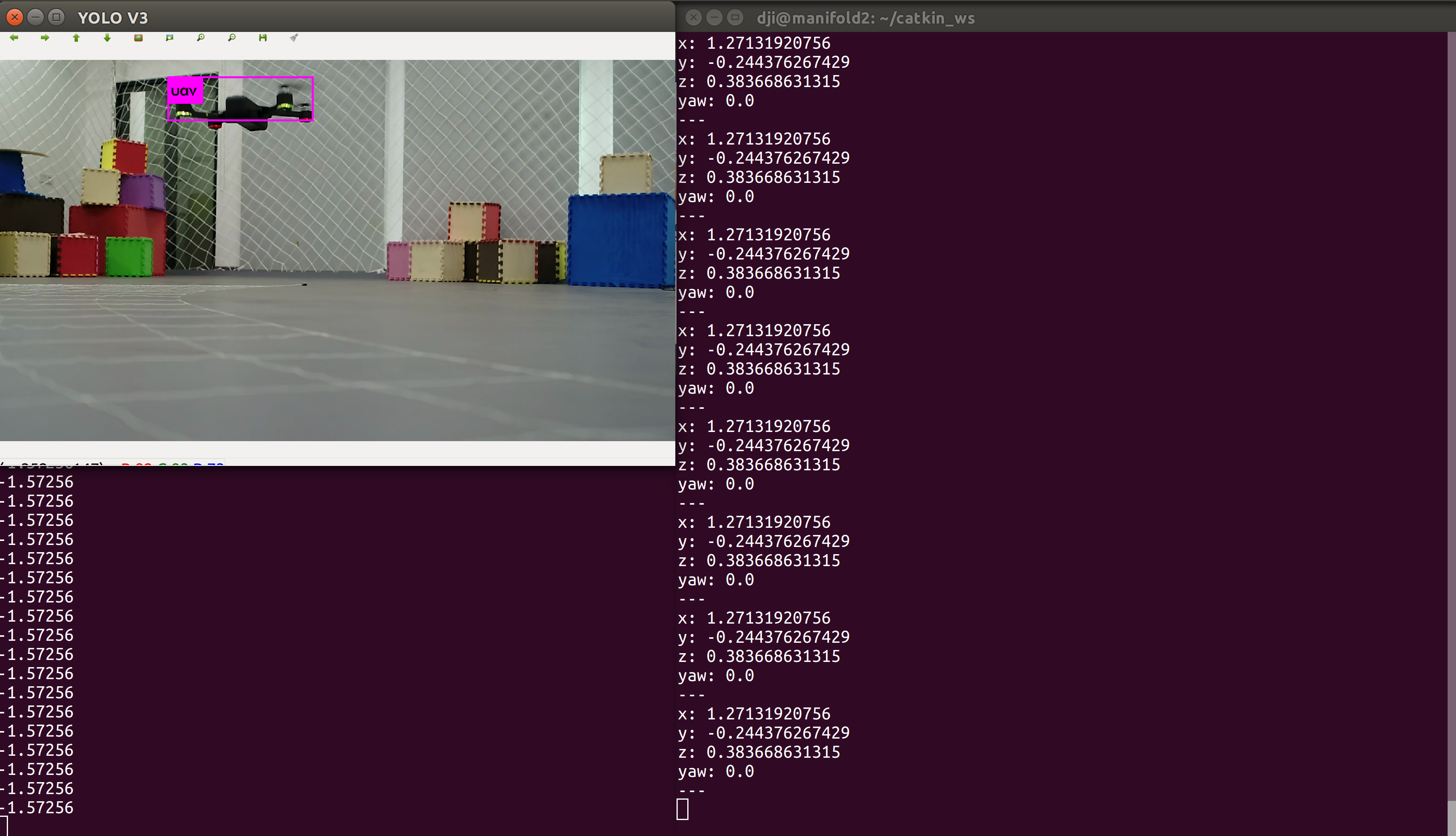

仿真:發現物體能向大致方向飛行,沒檢測到飛機會停住。

實驗:飛機沒檢測到無人機無法懸停,跟蹤不穩定。

1.很容易出現檢測不到無人機的情況,后面需要在新的場景中訓練數據集,并且需要在數據集中加入遠處的無人機的照片。

2.需要加入uav的probability閾值。

3.記錄寫下的所發點的坐標,寫入log文件,以便后面分析。

4.加入跟蹤算法(在ROS中比較麻煩)。

硬件軟件平臺的搭建

無人機平臺 :Dji M210 V2 (with RTK)

機載電腦:Manifold 2-G

相機: Zenmuse X7

開發環境:ROS and C++

ROS

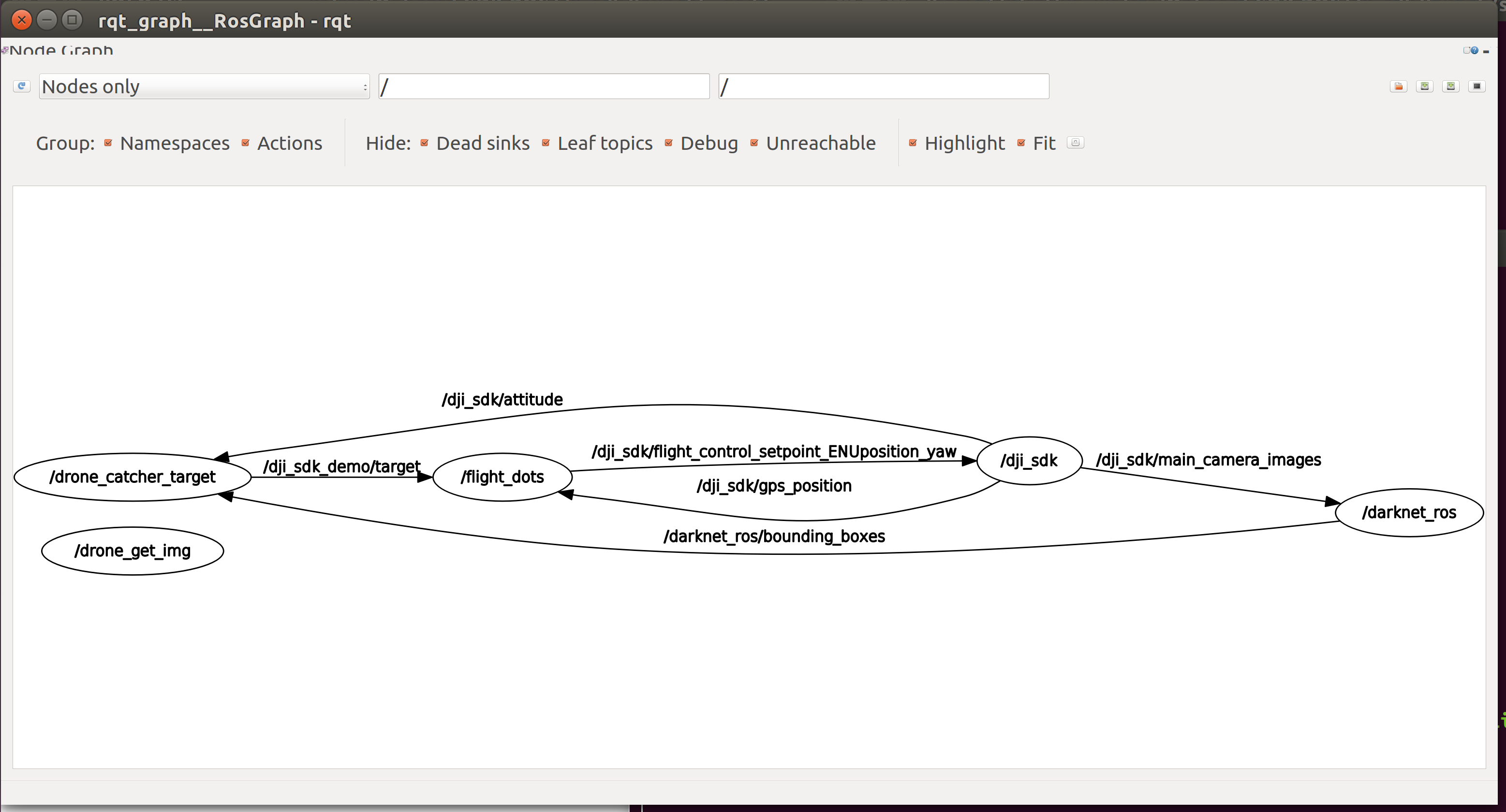

網絡圖

工作流程

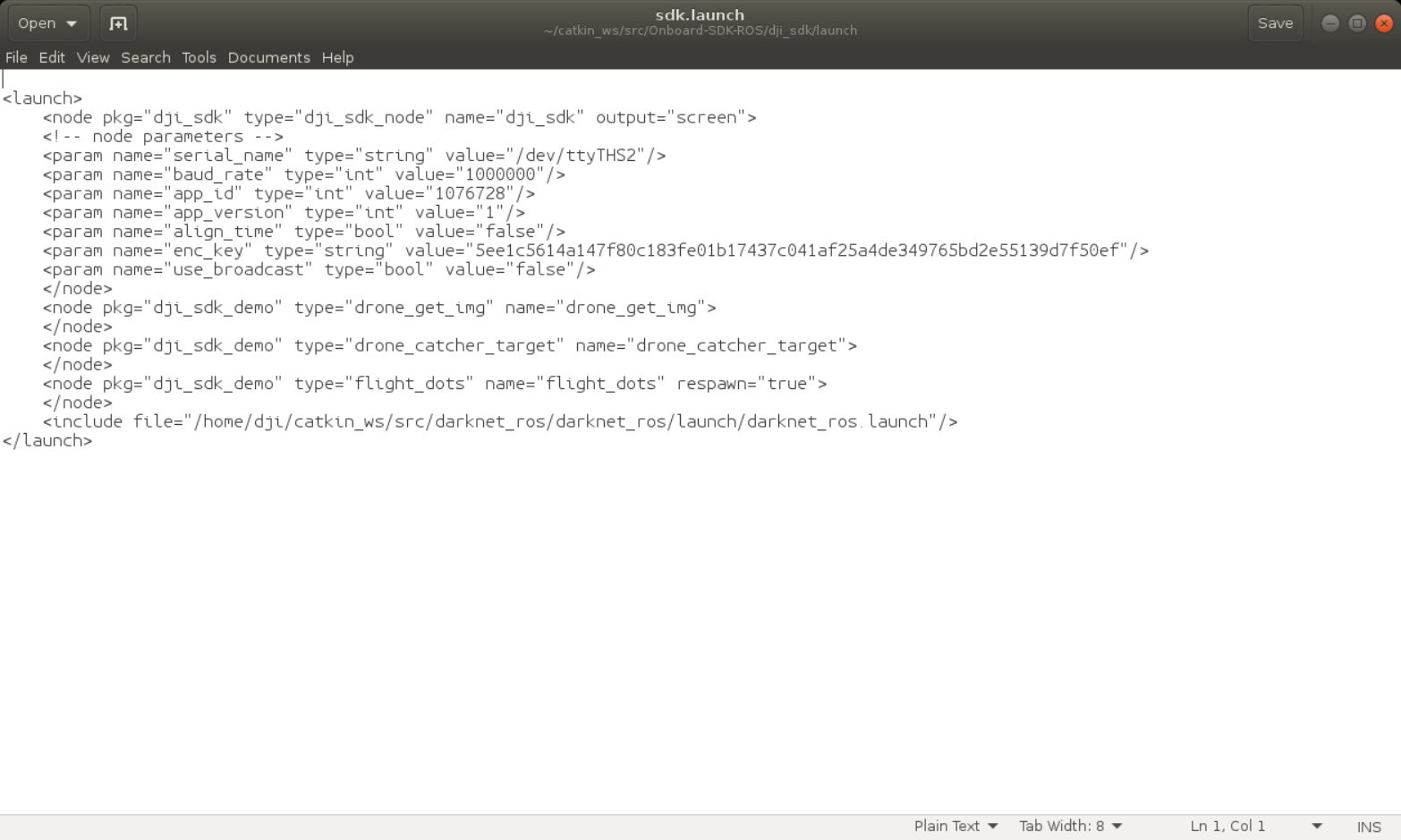

dji_sdk作為服務端發布setup_camera_stream服務,這個服務是darknet_ros訂閱main_camera_images的前提,需要drone_get_img這個節點召喚這個服務。

dji_sdk發布主相機(Zenmuse X7)的圖片(/dji_sdk/main_camera_images)給darknet_ros。

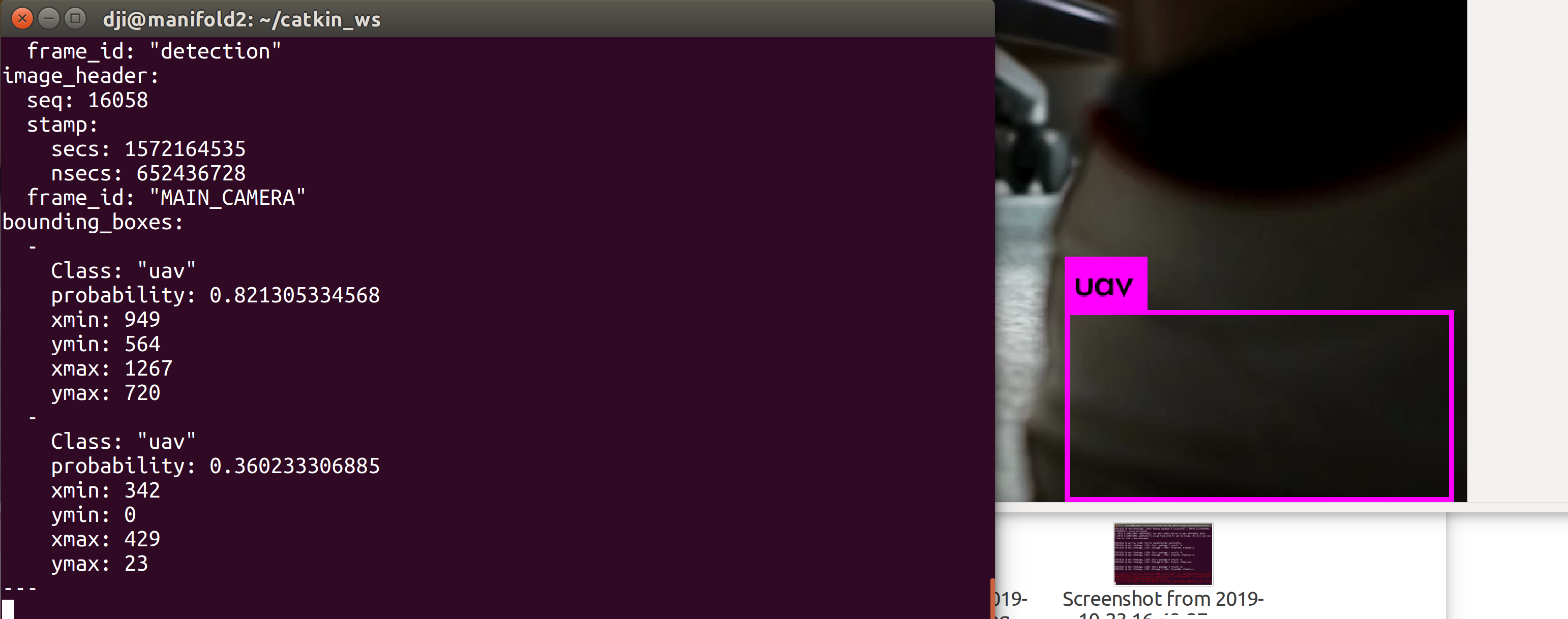

darknet_ros接受圖片并識別uav,把uav的信息(/darknet_ros/bounding_boxes)發布給drone_catcher_target。

drone_catcher_target接受uav的信息和飛機的姿態信息(/dji_sdk/attitude),利用圖片的信息和本身的姿態通過卡爾曼濾波將識別到的uav轉換成相對與飛機的ENU坐標,并將該坐標發布給flight_dots節點。

flight_dots與dji_sdk之間互相通信完成飛點。

節點介紹

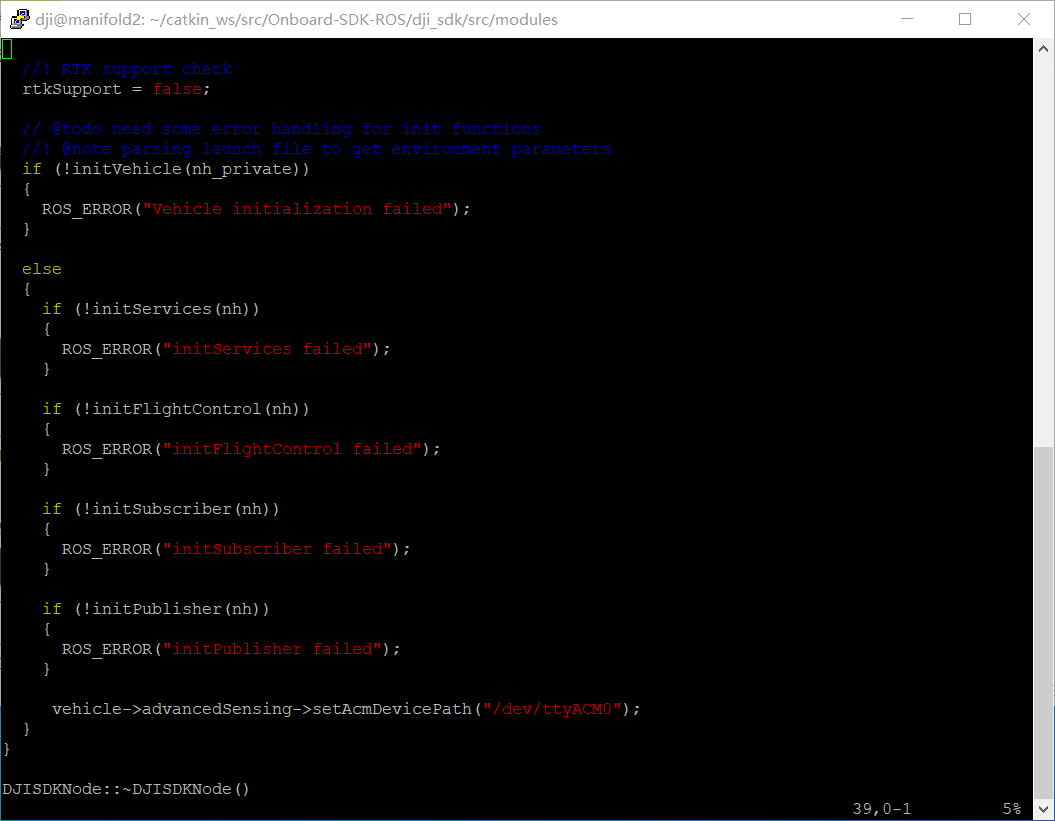

dji_sdk

初始化飛機的參數,發布一些例如飛機姿態的信息,發布一些有關飛機的功能的服務例如后續要用的camera_stream。

同時在這個節點中可以關閉advanced sensing功能,這個功能和Windows中的仿真互相矛盾,當要用到windows中DJI Assistant 2 For Matrice 的Simulator時,要將代碼中的

enable_advanced_sensing = true;

改為

enable_advanced_sensing = false;

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-KUJucyMX-1573643040093)(C:\Users\iusl\AppData\Roaming\Typora\typora-user-images\image-20191112204343151.png)]](https://img-blog.csdnimg.cn/20191113191312616.png)

還有當妙算與M210用USB相連時,妙算會把M210自動識別為USB device,此時遙控器上會黑屏,并且顯示X7 SD卡內存不足,此時需要將飛機標識為相機設備,具體方法為

vehicle->advancedSensing->setAcmDevicePath("/dev/ttyACM0");

啟發于linux版本的camera_stream_callback_sample例子。

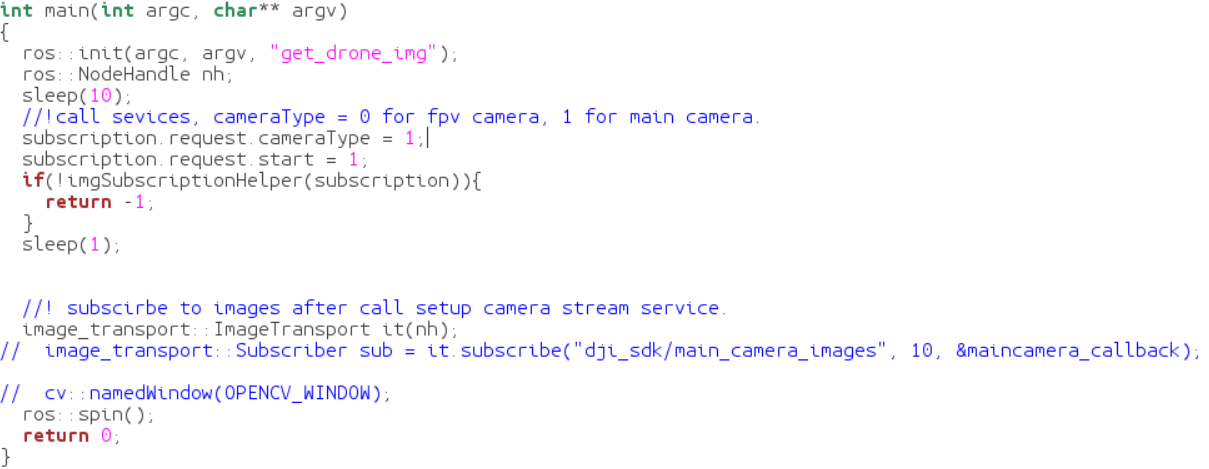

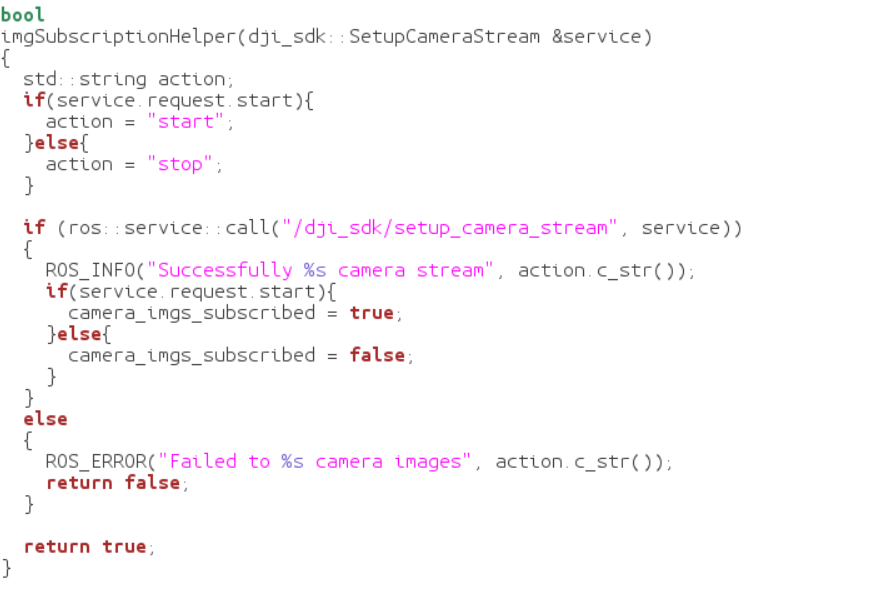

drone_get_img

call setup_camera_stream service for subscription of main_camera(x7).

darknet_ros

接受x7的圖像,識別圖像后發布bounding_box的對應信息(/darknet_ros/bounding_boxes)。

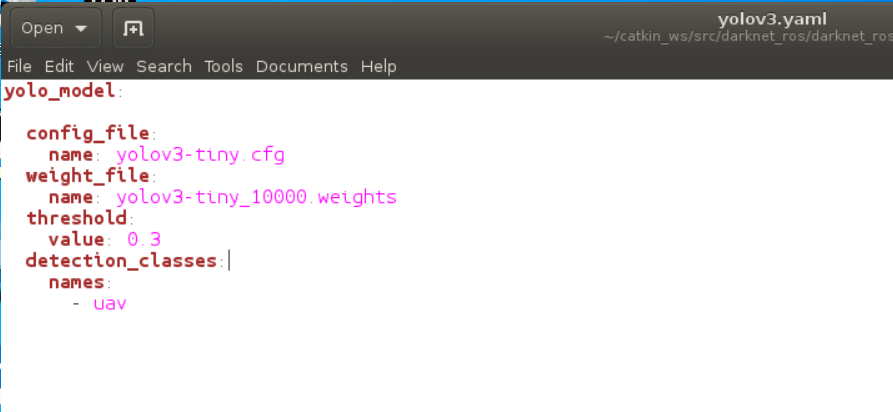

在~/catkin_ws/src/darknet_ros/darknet_ros/config/yolov3.yaml中修改權重文件(訓練集訓練后的結果)。

drone_catcher_target

受uav的信息和飛機的姿態信息(/dji_sdk/attitude),利用圖片的信息和本身的姿態通過卡爾曼濾波將識別到的uav轉換成相對與飛機的ENU坐標,并將該坐標發布給flight_dots節點(/dji_sdk_demo/target)。

void uav_coord_callback(const darknet_ros_msgs::BoundingBoxes::ConstPtr& msg)

{

static ros::Time start_time = ros::Time::now();

darknet_ros_msgs::BoundingBox boundingBox;

new_tar_exist = false;

if(!msg->bounding_boxes.empty()) // when camera detects the uav.

{

new_tar_exist = true; //indicates that new target shows up.

ros::Duration elapsed_time = ros::Time::now() - start_time;

start_time = ros::Time::now();

dt = elapsed_time.toSec(); // calculate the time between two successful dectections.

boundingBox = msg->bounding_boxes.at(0);

int xmax = boundingBox.xmax;

int xmin = boundingBox.xmin;

int ymax = boundingBox.ymax;

int ymin = boundingBox.ymin;

int u = (xmax + xmin)/2 - 640; //the size of the pic is 1280*720, indicating the coordinate of the origin is (640,360).

int v = (ymax + ymin)/2 - 360;

int length = xmax - xmin;

int width = ymax - ymin;

int longm = length > width ? length: width; //find the bigger value between length and width, giving it to longm.

double dist = 1956*exp(-0.02185*longm) + 314.8*exp(-0.002346*longm); //the parameter based on calibration work and MATLAB.

double thetaz = atan2(sqrt(u*u + v*v), 1325);

double thetab = atan2(v,u);

target.z = dist/100 * cos(thetaz);

target.x = dist/100 * sin(thetaz) * cos(thetab);

target.y = dist/100 * sin(thetaz) * sin(thetab);

if(!init_state) //initialize Matrix.

{

state_mear<<target.x, 0, target.y, 0, target.z, 0;

state_hat <<target.x, 0, target.y, 0, target.z, 0;

temp <<target.x, 0, target.y, 0, target.z, 0;

init_state = true;

}

state_mear<<target.x, (target.x-temp(0))/dt, target.y, (target.y-temp(2))/dt, target.z, (target.z-temp(4))/dt;

temp = state_mear;

}

}

main 函數里的一段。

ros::Rate r(20); // the average fps of the darknet_ros is about 17, so the rate will not be bigger than 20Hz.

while(ros::ok())

{

new_tar_exist = false; //reset the new_tar_exist.

ros::spinOnce();

if(new_tar_exist)

{

KF(F, Q, R, P, state_mear, state_hat);

//! frame transformation;

yaw = toEulerAngle(current_atti).z;

target.x = (state_hat(4) - 3)*sin(yaw) + state_hat(0)*cos(yaw); // leaving 3 meters gap between target and drone.

target.y = (state_hat(4) - 3)*cos(yaw) - state_hat(0)*sin(yaw);

target.z = -state_hat(2);

target_msg_pub.publish(target); // only when camera detects uav, the node publish message.

}

r.sleep();

}

測試:

符合情況

flight_dots

基于大疆的dji_sdk_demo包中的demo_flight_control.

接受drone_catcher_target發送的/dji_sdk_demo/target,并與dji_sdk通信協作飛點.

void target_callback(const dji_sdk_demo::target::ConstPtr& msg)

{

Target target;

target.x = msg->x;

target.y = msg->y;

target.z = msg->z;

target.yaw = msg->yaw;

target_list.push_back(target);

}

// when new target shows up, the drone will abandon current target to track the new target. a little logical problems.

void real_time_track()

{

Target new_tar = target_list.back(); // the newest target is at the back of target_list.

if(size_old <= target_list.size())

{ if(!square_mission.finished)

{

square_mission.step();

if(target_list.size() > size_old + 1)

{

new_tar = target_list.back();

square_mission.reset();

square_mission.start_gps_location = current_gps;

square_mission.start_local_position = current_local_pos;

square_mission.setTarget(new_tar.x, new_tar.y, new_tar.z,new_tar.yaw);

i = target_list.size() - 1;

square_mission.state = target_list.size();

size_old = target_list.size() + 1;

ROS_INFO("##### Start route %d ....", square_mission.state);

}

}

else

{

square_mission.reset();

square_mission.start_gps_location = current_gps;

square_mission.start_local_position = current_local_pos;

square_mission.setTarget(new_tar.x, new_tar.y, new_tar.z,new_tar.yaw);

i = target_list.size() - 1;

square_mission.state = target_list.size();

size_old = target_list.size() + 1;

ROS_INFO("##### Start route %d ....", square_mission.state);

}

}

}

launch file

仿真

dji自帶的仿真很不方便,但勉強也夠用,主要有兩種方法。

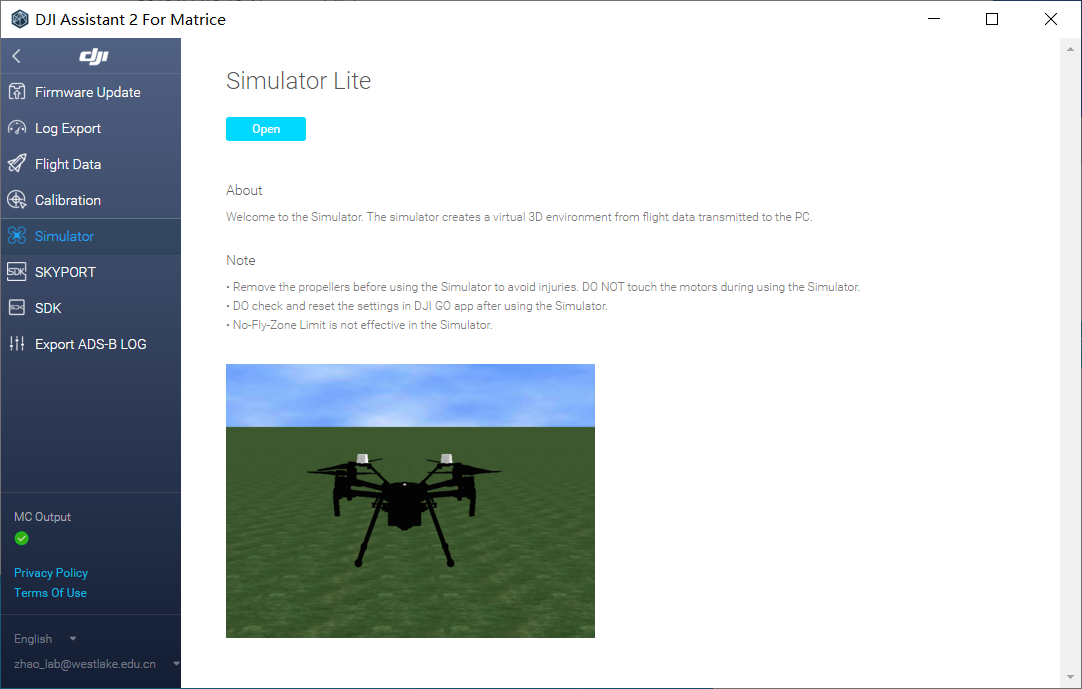

windows環境

1.連接好線材。

USB連接windows的電腦和M210。

2.打開遙控器,打開飛機。

3.在Windows上打開DJI Assistant 2 For Matrice,打開Simulator,有時候仿真的界面有些必要的信息沒有展示,這時候關掉仿真,重開就行了。

4.運行需要仿真的指令。

運行

roslaunch dji_sdk sdk_test_fd.launch

其中我創建了另一個節點,關閉了advanced sensing 和標記飛機為USB device.這樣就不用每次仿真都得重新編譯了。

5.關閉仿真,關掉飛機。

Linux環境

1.線材連接與實地實驗時一致,不過要將妙算連上顯示器。

2.打開遙控器和飛機。

3.在Onboard-SDK/utility/bin中運行

./M210ConfigTool --usb-port /dev/ttyACM0 --config-file UserConfig.txt --simulation on --latitude 37.422083 --longitude -122.137390

4.運行需要仿真的指令,可以看遙控器中的速度等信息來判斷仿真結果。

5.運行

./M210ConfigTool --usb-port /dev/ttyACM0 --config-file UserConfig.txt --simulation off --latitude 37.422083 --longitude -122.137390

關閉仿真。

6.關閉飛機。

Bug list/Tips

1.advanced sensing功能和windows上的仿真功能相沖突。

2.在M210中要訂閱main_camera_images要先call setup_camera_stream service.

3.按照大疆官網給妙算2-G安裝opencv時會出現兩個問題

一個是error:‘std::shared_ptr’ has not been declared.

解決辦法是在cmake 命令行里加入 -D CMAKE_CXX_STANDARD=11, 因為查到std::shared_ptr是要C++11編譯的。

另一個是出現undefined reference to ‘cv::cuda’,解決辦法是在相應文件的CMakeLists.txt中加入set(OpenCV_DIR “…/opencv/build”)。

4.因為內存不足,我把openCV裝在了128G的自帶硬盤里,每次開機重啟對ROS包再進行編譯的時候又會出現undefined referenced 的問題,這時候解決辦法就是到opencv/build的路徑下,復制路徑,重新粘貼到CMakeLists.txt中,問題又解決了。具體原因不明,若要解決這個問題,可能要把opencv直接安裝在妙算上。

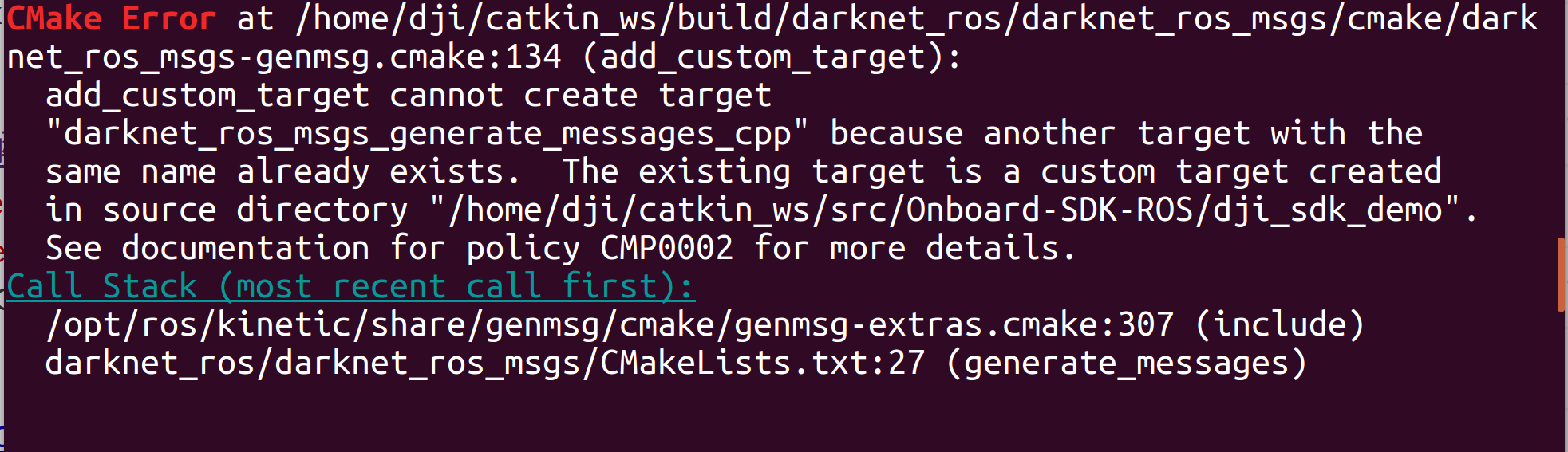

5.darknet包的編譯,一共有三個問題。

第一個問題

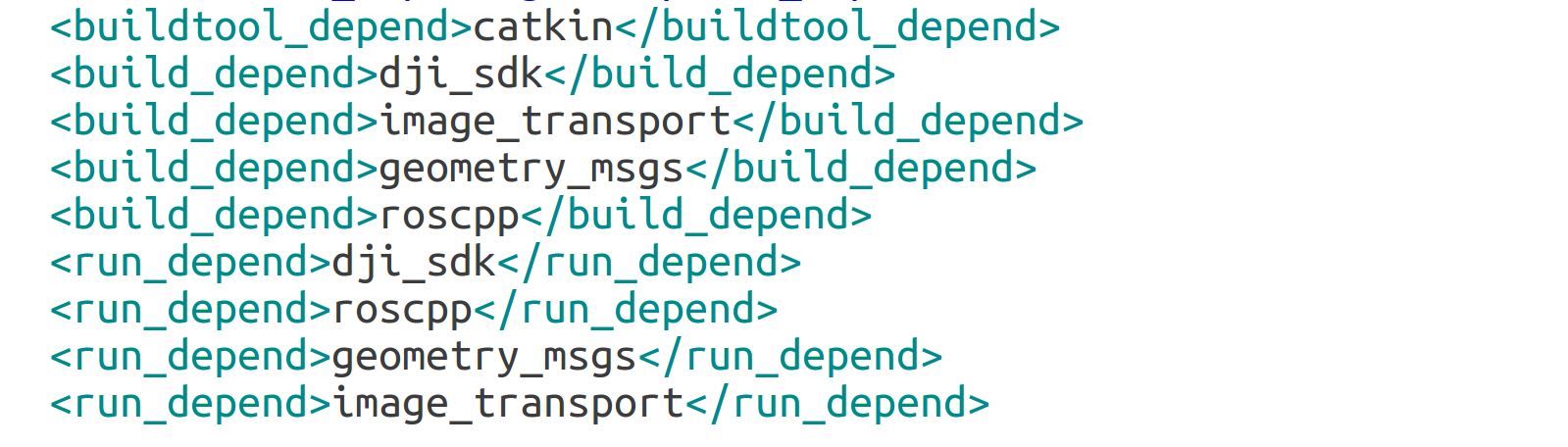

個問題產生的原因是dji_sdk_demo包中的package.xml和CMakeLists.txt中的依賴不一樣,修改了即可。

個問題產生的原因是dji_sdk_demo包中的package.xml和CMakeLists.txt中的依賴不一樣,修改了即可。

我在package.xml中加入了image_transport的build depend 和run depend.

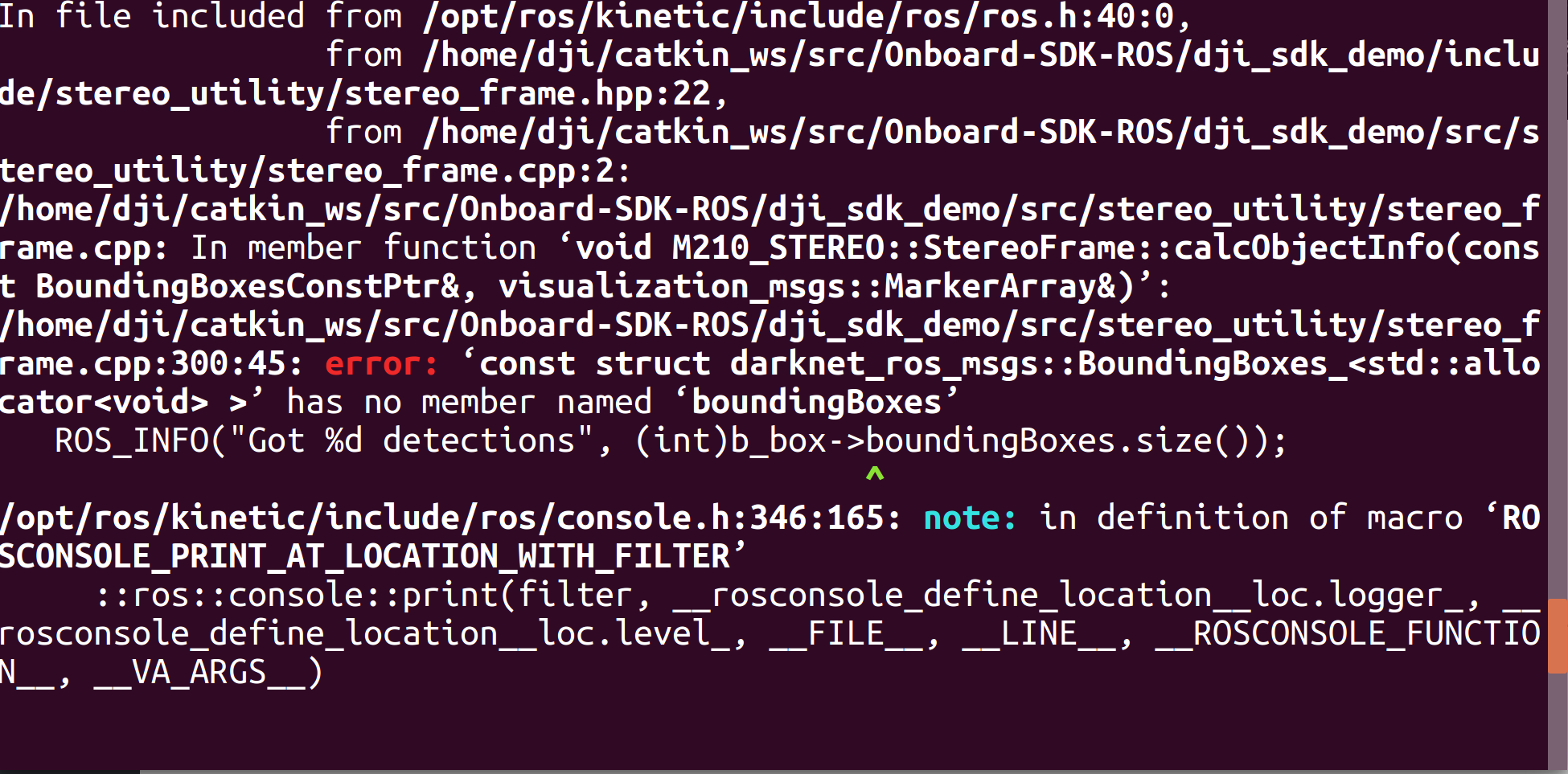

第二個問題

我看了一下darknet_ros_msgs中BoundingBoxes消息中的數據,發現并沒有boundingBoxes只有bounding_boxes,因此解決方法是把/stereo_frame.cpp中的BoundingBoxes改成bounding_boxes即可編譯通過。

第三個問題

在運行darknet包的時候遇到了CUDA Error::_ _ global_ _ function call is not configured.

解決辦法是到NVIDIA官網下載cudnn,安裝之后在~/catkin_ws/src/Onboard-SDK-ROS/dji_sdk_demo/CMakeLists.txt中的CUDA區域內加入了add _definitions( -DGPU -DCUDNN).

6.x7搭載在飛機上,USB連接妙算和飛機時,遙控器會顯示SD卡內存不足,解決辦法是在dji_sdk_node的構造函數的最后加上

vehicle->advancedSensing->setAcmDevicePath("/dev/ttyACM0")

7.darknet_ros處理后的圖像尺寸為1280*720,對原有圖像會有一定程度的裁剪。

8.諾曼巴飛機室內飛行時GPS模式定不準,建議室內飛行時帶手套飛行,有炸機風險。

9.遙控器的顯示屏有時候會顯示連接不到飛機,這時候把顯示屏與遙控器的接口拔了,連上USB線重啟即可。

10.ROS中可以直接使用矩陣,方法是在CMakeLists.txt中加入

find_package(cmake_modules REQUIRED)

find_package(Eigen3 REQUIRED)

include_directories(${EIGEN3_INCLUDE_DIR})

add_definitions(${EIGEN_DEFINITIONS})

并在頭文件中加入所要的庫。

#include <Eigen/Dense>

11.drone_get_img建議在dji_sdk_node之后10s左右開啟,因為dji_sdk_node大概要10s左右發送所有的服務消息。

ros::spinOnce()

這個函數的作用是把已發布話題的回調函數都執行一遍,若在回調函數中執行重復性工作時需要注意這點。

13.有時候啟動dji_sdk_node和darknet_ros時,會出現Unable to read from Main camera,具體原因不知道,目前屬于概率事件,這時候電腦上是不會出現識別的窗口的,解決辦法是重新運行和重新開機,如果還不行就多試試幾遍。

智能推薦

freemarker + ItextRender 根據模板生成PDF文件

1. 制作模板 2. 獲取模板,并將所獲取的數據加載生成html文件 2. 生成PDF文件 其中由兩個地方需要注意,都是關于獲取文件路徑的問題,由于項目部署的時候是打包成jar包形式,所以在開發過程中時直接安照傳統的獲取方法沒有一點文件,但是當打包后部署,總是出錯。于是參考網上文章,先將文件讀出來到項目的臨時目錄下,然后再按正常方式加載該臨時文件; 還有一個問題至今沒有解決,就是關于生成PDF文件...

電腦空間不夠了?教你一個小秒招快速清理 Docker 占用的磁盤空間!

Docker 很占用空間,每當我們運行容器、拉取鏡像、部署應用、構建自己的鏡像時,我們的磁盤空間會被大量占用。 如果你也被這個問題所困擾,咱們就一起看一下 Docker 是如何使用磁盤空間的,以及如何回收。 docker 占用的空間可以通過下面的命令查看: TYPE 列出了docker 使用磁盤的 4 種類型: Images:所有鏡像占用的空間,包括拉取下來的鏡像,和本地構建的。 Con...

requests實現全自動PPT模板

http://www.1ppt.com/moban/ 可以免費的下載PPT模板,當然如果要人工一個個下,還是挺麻煩的,我們可以利用requests輕松下載 訪問這個主頁,我們可以看到下面的樣式 點每一個PPT模板的圖片,我們可以進入到詳細的信息頁面,翻到下面,我們可以看到對應的下載地址 點擊這個下載的按鈕,我們便可以下載對應的PPT壓縮包 那我們就開始做吧 首先,查看網頁的源代碼,我們可以看到每一...

猜你喜歡

Linux C系統編程-線程互斥鎖(四)

互斥鎖 互斥鎖也是屬于線程之間處理同步互斥方式,有上鎖/解鎖兩種狀態。 互斥鎖函數接口 1)初始化互斥鎖 pthread_mutex_init() man 3 pthread_mutex_init (找不到的情況下首先 sudo apt-get install glibc-doc sudo apt-get install manpages-posix-dev) 動態初始化 int pthread_...

統計學習方法 - 樸素貝葉斯

引入問題:一機器在良好狀態生產合格產品幾率是 90%,在故障狀態生產合格產品幾率是 30%,機器良好的概率是 75%。若一日第一件產品是合格品,那么此日機器良好的概率是多少。 貝葉斯模型 生成模型與判別模型 判別模型,即要判斷這個東西到底是哪一類,也就是要求y,那就用給定的x去預測。 生成模型,是要生成一個模型,那就是誰根據什么生成了模型,誰就是類別y,根據的內容就是x 以上述例子,判斷一個生產出...

styled-components —— React 中的 CSS 最佳實踐

https://zhuanlan.zhihu.com/p/29344146 Styled-components 是目前 React 樣式方案中最受關注的一種,它既具備了 css-in-js 的模塊化與參數化優點,又完全使用CSS的書寫習慣,不會引起額外的學習成本。本文是 styled-components 作者之一 Max Stoiber 所寫,首先總結了前端組件化樣式中的最佳實踐原則,然后在此基...

19.vue中封裝echarts組件

19.vue中封裝echarts組件 1.效果圖 2.echarts組件 3.使用組件 按照組件格式整理好數據格式 傳入組件 home.vue 4.接口返回數據格式...