Python3爬蟲之Scrapy框架入門

Python3爬蟲之Scrapy框架

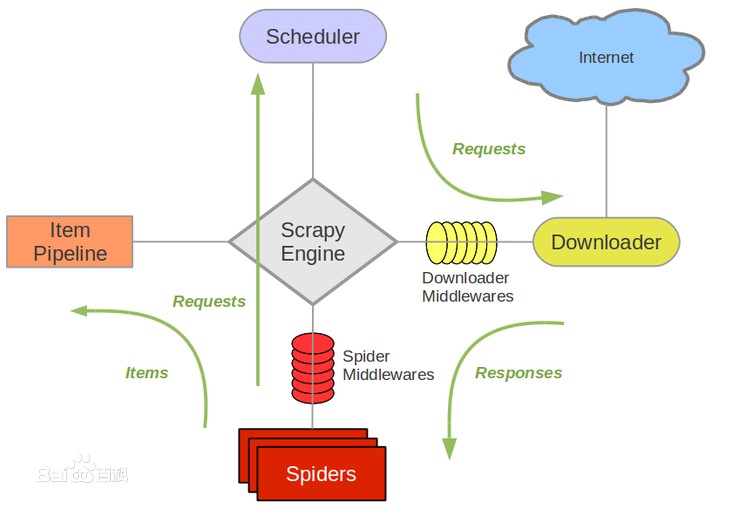

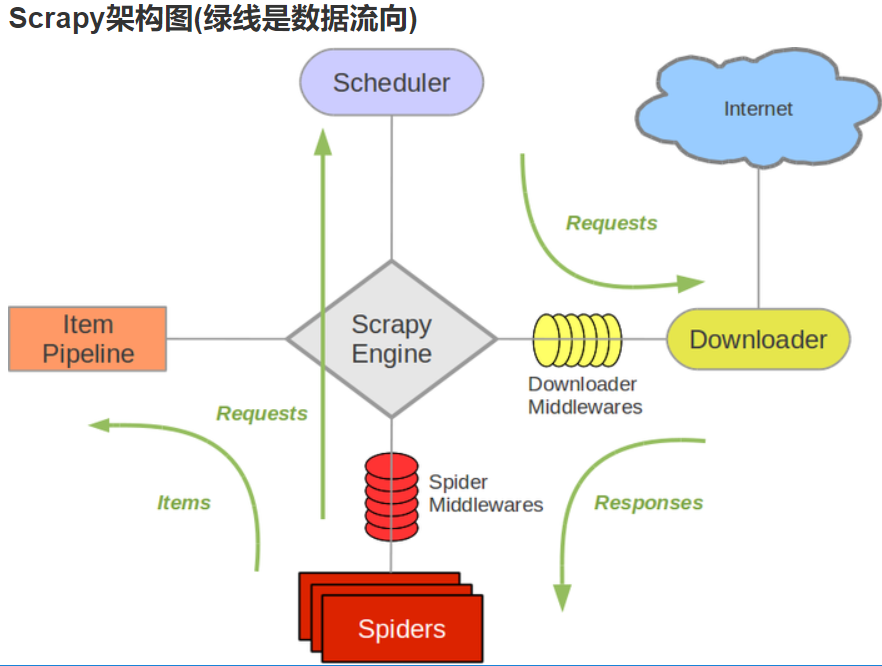

Scrapy架構圖

- Scrapy Engine(引擎): 負責Spider、ItemPipeline、Downloader、Scheduler中間的通訊,信號、數據傳遞等。

- Scheduler(調度器): 它負責接受引擎發送過來的Request請求,并按照一定的方式進行整理排列,入隊,當引擎需要時,交還給引擎。

- Downloader(下載器):負責下載Scrapy Engine(引擎)發送的所有Requests請求,并將其獲取到的Responses交還給Scrapy Engine(引擎),由引擎交給Spider來處理,

- Spider(爬蟲):它負責處理所有Responses,從中分析提取數據,獲取Item字段需要的數據,并將需要跟進的URL提交給引擎,再次進入Scheduler(調度器).

- Item Pipeline(管道):它負責處理Spider中獲取到的Item,并進行進行后期處理(詳細分析、過濾、存儲等)的地方。

- Downloader Middlewares(下載中間件):你可以當作是一個可以自定義擴展下載功能的組件。

- Spider Middlewares(Spider中間件):你可以理解為是一個可以自定擴展和操作引擎和Spider中間通信的功能組件(比如進入Spider的Responses;和從Spider出去的Requests)

Scrapy的運作流程

代碼寫好,程序開始運行…

- 1 引擎:Hi!Spider, 你要處理哪一個網站?

- 2 Spider:老大要我處理xxxx.com。

- 3 引擎:你把第一個需要處理的URL給我吧。

- 4 Spider:給你,第一個URL是xxxxxxx.com。

- 5 引擎:Hi!調度器,我這有request請求你幫我排序入隊一下。

- 6 調度器:好的,正在處理你等一下。

- 7 引擎:Hi!調度器,把你處理好的request請求給我。

- 8 調度器:給你,這是我處理好的request

- 9 引擎:Hi!下載器,你按照老大的下載中間件的設置幫我下載一下這個request請求

- 10 下載器:好的!給你,這是下載好的東西。(如果失敗:sorry,這個request下載失敗了。然后引擎告訴調度器,這個request下載失敗了,你記錄一下,我們待會兒再下載)

- 11 引擎:Hi!Spider,這是下載好的東西,并且已經按照老大的下載中間件處理過了,你自己處理一***意!這兒responses默認是交給def parse()這個函數處理的)

- 12 Spider:(處理完畢數據之后對于需要跟進的URL),Hi!引擎,我這里有兩個結果,這個是我需要跟進的URL,還有這個是我獲取到的Item數據。

- 13 引擎:Hi !管道 我這兒有個item你幫我處理一下!調度器!這是需要跟進URL你幫我處理下。然后從第四步開始循環,直到獲取完老大需要全部信息。

- 14 管道調度器:好的,現在就做!

注意!只有當調度器中不存在任何request了,整個程序才會停止,(也就是說,對于下載失敗的URL,Scrapy也會重新下載。)

Scrapy 安裝

pip install Scrapy

制作 Scrapy 爬蟲四板斧

- 新建項目 (scrapy startproject xxx):新建一個新的爬蟲項目

- 明確目標 (編寫items.py):明確你想要抓取的目標

- 制作爬蟲 (spiders/xxspider.py):制作爬蟲開始爬取網頁

- 存儲內容 (pipelines.py):設計管道存儲爬取內容

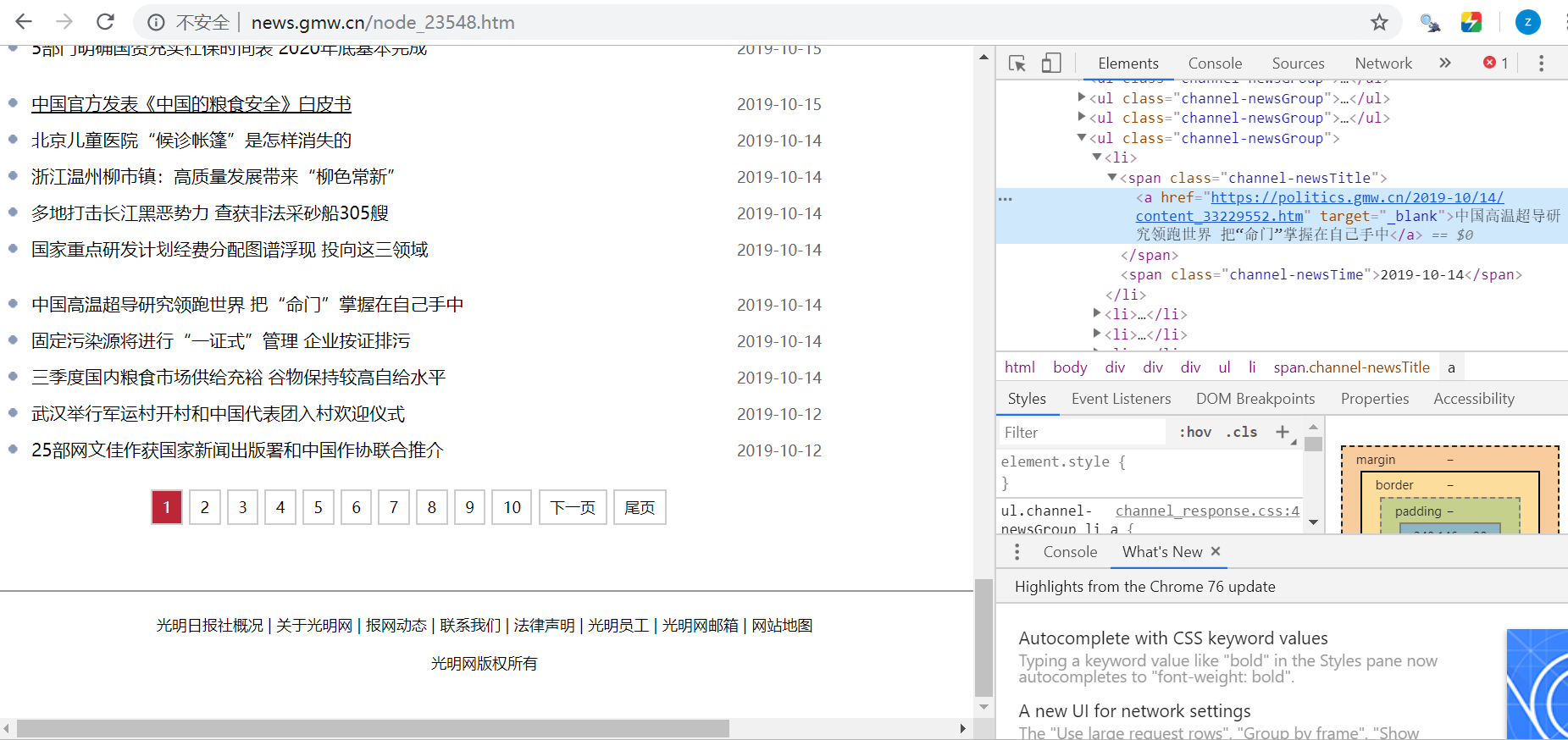

入門項目

? 需求:爬取傳智講師姓名、職位、個人信息

y):設計管道存儲爬取內容

入門項目

? 需求:爬取傳智講師姓名、職位、個人信息

Python系列CSDN博客地址:

如需更系統學習,下面是博主關于Python爬蟲的系列學習博客

智能推薦

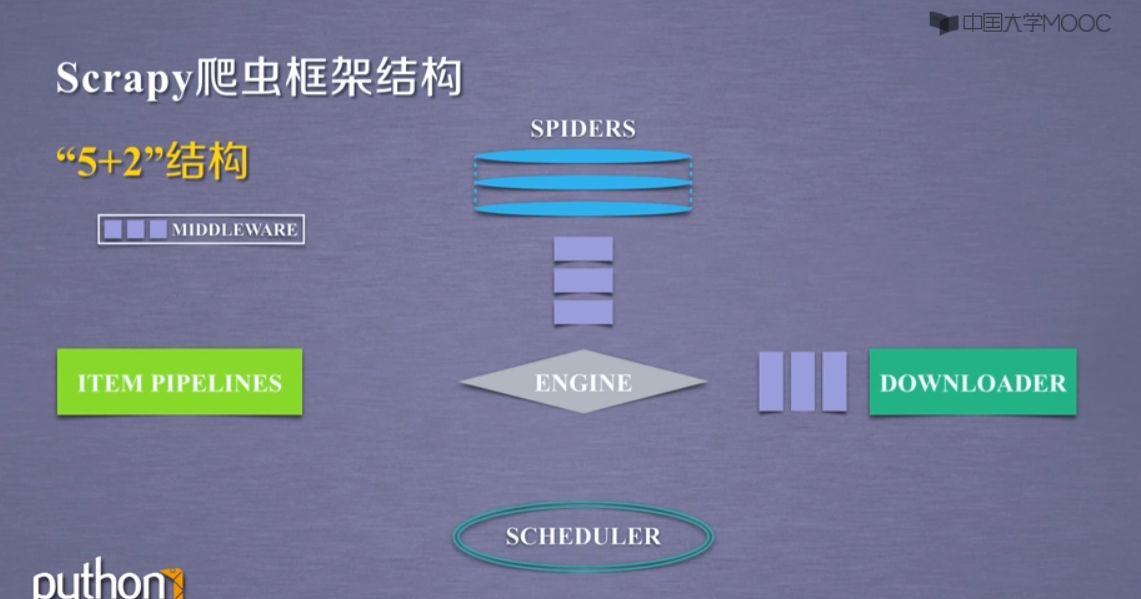

Scrapy框架入門

Scrapy簡介 Scrapy框架是使用Python開發的一個快速、高層次的屏幕抓取和web抓取框架,用于抓取web站點并從頁面中提取結構化的數據。Scrapy用途廣泛,可以用于數據挖掘、監測和自動化測試 Scrapy不僅有單機版,開發者還可以使用其集群版Scrapy-redis開發分布式爬蟲程序,分布式爬蟲有更快的速度和更高的效率 Scrapy用途非常廣泛,用戶只需要定制開發幾個模塊就可以輕松的...

scrapy框架入門

scrapy框架入門 一、Scrapy框架介紹 1.框架簡介 Scrapy是純Python開發的一個高效,結構化的網頁抓取框架 Scrapy使用了Twisted 異步網絡庫來處理網絡通訊 Scrapy是為了爬取網站數據,提取結構性數據而編寫的應用框架 Scrapy用途廣泛,可以用于數據挖掘、監測和自動化測試 2.模塊安裝 scrapy支持Python2.7和python3.4以上版本 python...

scrapy框架入門

scrapy框架 Scrapy是用純Python實現一個為了爬取網站數據、提取結構性數據而編寫的應用框架,用途非常廣泛。 框架的力量,用戶只需要定制開發幾個模塊就可以輕松的實現一個爬蟲,用來抓取網頁內容以及各種圖片,非常之方便。 Scrapy 使用了 Twisted’tw?st?d異步網絡框架來處理網絡通訊,可以加快我們的下載速度,不用自己去實現異步框架,并且包含了各種中間件接口,可以...

scrapy框架入門

最近在學習爬蟲,這里是MOOC北理嵩天老師的課程筆記,適合小白入門。 如果想自己寫一個scrapy框架出來,建議自己鉆研幾個實例,理解每一行語句的作用,應該三天左右就可以上手。 當然,我們還需要掌握re, xpath, BeautifulSoup 等基礎知識。 歡迎大佬指正~ 數據,包括用戶提供的網絡爬蟲請求,以及從網絡上獲取的相關內容,在這些結構直接相互流動形成了數據流。 路徑1:請求通過SPI...

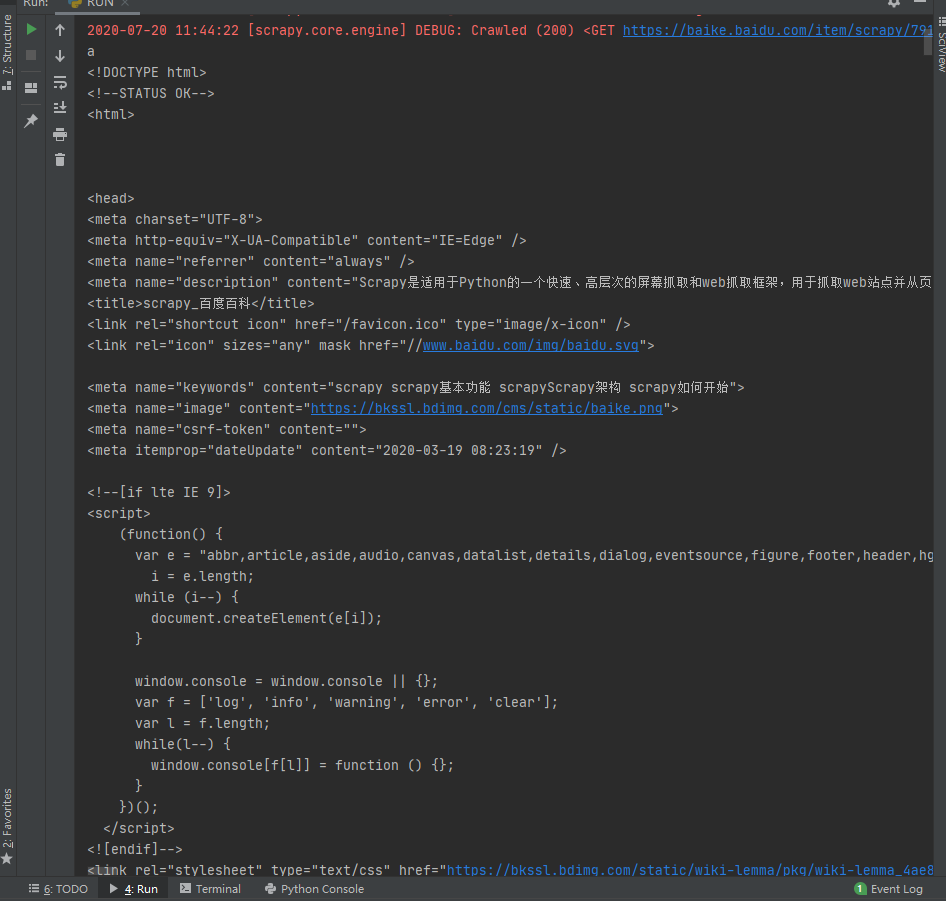

Scrapy框架入門

1. 創建爬蟲 cmd 或 powershell 或 bash 創建爬蟲命令: cmd打開方式:win + R ,輸入cmd,回車。 powershell:win + S,輸入powershell,回車。 bash:Linux下,ctrl + alt + T。 2. 核心類Spider 以爬取Scrapy百度百科為例。 首先在setting中關閉網頁爬蟲檢查: 然后在spiders目錄下創建Spi...

猜你喜歡

freemarker + ItextRender 根據模板生成PDF文件

1. 制作模板 2. 獲取模板,并將所獲取的數據加載生成html文件 2. 生成PDF文件 其中由兩個地方需要注意,都是關于獲取文件路徑的問題,由于項目部署的時候是打包成jar包形式,所以在開發過程中時直接安照傳統的獲取方法沒有一點文件,但是當打包后部署,總是出錯。于是參考網上文章,先將文件讀出來到項目的臨時目錄下,然后再按正常方式加載該臨時文件; 還有一個問題至今沒有解決,就是關于生成PDF文件...

電腦空間不夠了?教你一個小秒招快速清理 Docker 占用的磁盤空間!

Docker 很占用空間,每當我們運行容器、拉取鏡像、部署應用、構建自己的鏡像時,我們的磁盤空間會被大量占用。 如果你也被這個問題所困擾,咱們就一起看一下 Docker 是如何使用磁盤空間的,以及如何回收。 docker 占用的空間可以通過下面的命令查看: TYPE 列出了docker 使用磁盤的 4 種類型: Images:所有鏡像占用的空間,包括拉取下來的鏡像,和本地構建的。 Con...

requests實現全自動PPT模板

http://www.1ppt.com/moban/ 可以免費的下載PPT模板,當然如果要人工一個個下,還是挺麻煩的,我們可以利用requests輕松下載 訪問這個主頁,我們可以看到下面的樣式 點每一個PPT模板的圖片,我們可以進入到詳細的信息頁面,翻到下面,我們可以看到對應的下載地址 點擊這個下載的按鈕,我們便可以下載對應的PPT壓縮包 那我們就開始做吧 首先,查看網頁的源代碼,我們可以看到每一...